퇴근길, 영동고속도로 동수원 IC를 빠져나오며 차선이 살짝 지워진 구간을 지나는데 어김없이 오토파일럿이 요란한 경고음을 울리며 풀려버렸습니다. 이미 그럴거라고 알고있었기 때문에 여유롭게 운전대를 잡은 저. 그러고나서 밤에 유튜브를 보는데 미국 유저들이 올린 FSD(Full Self-Driving) V14 주행 영상을 보니 기가 막히네요. 비보호 좌회전은 기본이고, 갑자기 튀어나오는 자전거를 부드럽게 피해 가거나 공사판의 복잡한 꼬깔콘 사이를 사람보다 더 자연스럽게 스르륵 빠져나가거든요.

똑같이 테슬라 로고가 박힌 차를 타면서, 저는 고속도로 톨게이트만 나오면 버벅거리는 오토파일럿에 의존해야 하는 것과 비교하니까 너무너무 부러웠던거 있죠. 오토파일럿 기능 하나만으로도 훌륭하다고 생각하고 있었는데, 저 바다 건너에서 벌어지고 있는 FSD의 진화 속도가 너무나 경이롭습니다. 우리나라에서도 모델 X나 모델 S도 가능하긴 하지만, 어쨌든! 도대체 저 미국 땅을 달리는 테슬라 차량 내부의 컴퓨터에서는 어떤 연산이 일어나길래 이토록 차원이 다른 주행이 가능한 걸까요? 매일같이 반도체 회로도와 씨름하며 칩의 효율을 쥐어짜 내는 제 입장에서, FSD의 근본적인 작동 원리를 칩과 알고리즘의 관점에서 조금 알아보도록 하겠습니다.

수십만 줄의 C++ 코드를 불태우다: 엔드투엔드(End-to-End)의 혁명

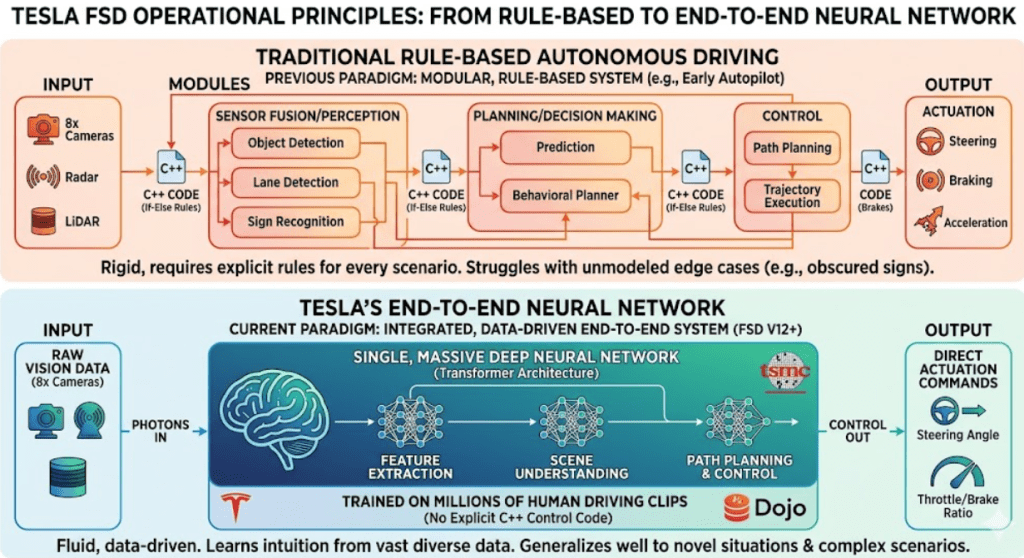

오토파일럿과 FSD의 차이를 단순히 ‘도심 주행 기능이 추가되었다’ 정도로 이해하면 곤란합니다. 이 둘은 뇌를 구성하는 근본적인 아키텍처 자체가 다릅니다. 제가 매일 쓰는 오토파일럿이나 기존 자율주행 기술들은 기본적으로 모듈화된 ‘규칙 기반(Rule-based)’ 시스템이었습니다. 카메라가 차선을 인식하는 모듈, 장애물을 분류하는 모듈, 그리고 이를 바탕으로 브레이크를 밟을지 말지 결정하는 제어 모듈이 다 따로 놀았죠. 엔지니어들이 수십만 줄의 C++ 코드를 짜서 “만약(If) 앞에 정지 표지판이 보이면, 브레이크를 밟아라(Else)”라고 일일이 규칙을 정해준 겁니다. 하지만 세상 모든 변수를 코드로 짤 수는 없습니다. 비가 와서 표지판이 가려지거나 찌그러진 표지판이 등장하면 시스템은 에러를 뿜어냅니다.

하지만 테슬라 FSD V12부터는 이 복잡한 코딩의 산물과 바이바이하고, 완벽한 ‘엔드투엔드(End-to-End) 신경망’으로 갈아탔습니다. 비전 데이터가 입력(Input)층으로 들어오면, 중간에 인간이 개입하는 규칙이나 코드 없이, 거대한 인공지능 신경망이 곧바로 운전대 조향각과 페달의 가감속 비율이라는 결과값(Output)을 뱉어냅니다. 마치 어린아이가 자전거 타는 법을 배울 때 “페달을 몇 도 각도로 밟고 핸들을 몇 뉴턴의 힘으로 꺾어라”라고 배우지 않고, 수많은 넘어짐과 감각을 통해 통째로 학습하는 것과 완벽히 같은 이치입니다. 수백만 대의 테슬라 차량이 모아 온 ‘인간의 베스트 드라이빙 영상’을 통째로 신경망에 먹여버리니, AI가 스스로 코너링의 감을 잡고 비포장도로에서의 대처법을 터득해 버린 것입니다.

‘Photon in, Control out’을 구현하는 FSD 하드웨어의 미친 전성비

빛(Photon)이 렌즈를 통과해 이미지 센서에 맺힌 날것의 데이터가 곧바로 자동차의 바퀴를 굴리는 제어(Control) 신호로 바뀐다는 건 소프트웨어적으로는 아름답지만, 이를 실시간으로 처리해야 하는 반도체 하드웨어 입장에서는 그야말로 재앙에 가까운 가혹한 조건입니다. 시속 100km로 달리는 차 안에서, 8대의 카메라가 초당 36프레임씩 쏟아내는 고해상도 영상을 단 몇 밀리초(ms) 만에 딜레이 없이 분석해 내야 하니까요. 여기서 테슬라가 자체 설계한 FSD 칩(Hardware 4.0 및 향후 5.0)의 진가가 드러납니다.

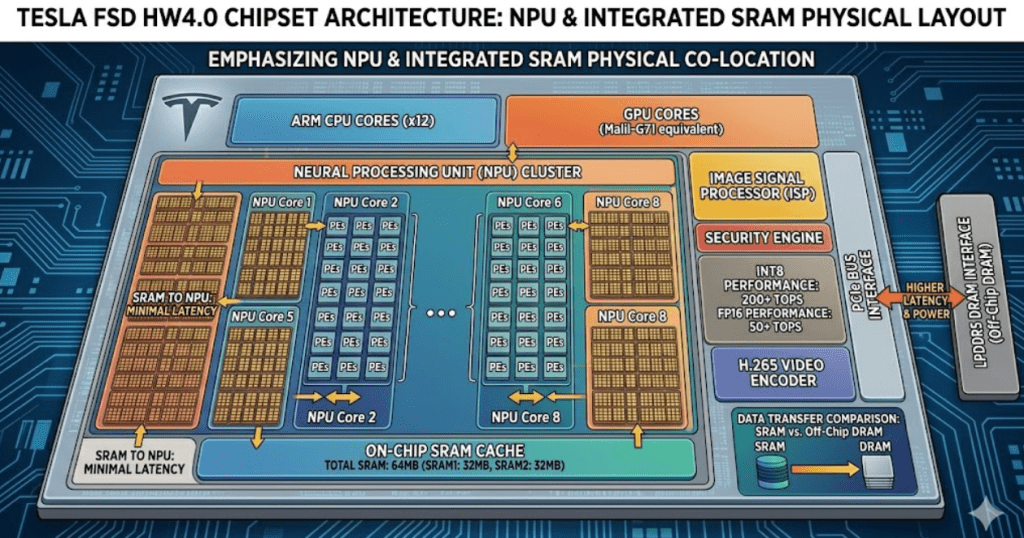

우리가 흔히 아는 엔비디아(NVIDIA)의 거대한 GPU는 성능은 좋지만 차에 달기엔 전기를 너무 많이 먹고 발열이 감당 안 됩니다. 테슬라는 이 문제를 해결하기 위해 FSD 칩 내부의 NPU(신경망 처리 장치)에 막대한 용량의 SRAM을 캐시 메모리로 때려 박았습니다. 데이터를 칩 외부의 D램에서 가져오면 속도도 느리고 전력 소모도 커지기 때문에, 아예 연산기(MAC) 바로 옆에 자주 쓰는 데이터를 쌓아두고 병목 현상(Bottleneck)을 원천 차단해 버리겠다는 의도죠. 또한 부동소수점 연산의 정밀도를 살짝 낮추는 대신 정수 연산(INT8) 처리량을 극대화하여 추론(Inference) 속도를 비약적으로 끌어올렸습니다. 이 극한의 하드웨어 맞춤 설계가 없었다면, 아무리 훌륭한 엔드투엔드 인공지능 모델이라도 글러브 박스 안에서 불타오르거나 화면이 버벅거리며 대형 사고를 냈을 것입니다. 자동차라는 제한된 폼팩터 안에서 AI 모델을 돌리는 것은 결국 ‘발열’과 ‘전성비’를 잡는 물리적인 싸움입니다.

더 이상 칩의 문제가 아니다: 데이터와 컴퓨팅 파워의 스케일링 법칙

현재 FSD가 보여주는 마법 같은 주행은 사실 차량 내부의 칩이 해낸 결과라기보다는, 테슬라에 구축된 거대한 슈퍼컴퓨터 생태계의 승리라고 볼 수 도 있을거 같아요. 차 안에 탑재된 FSD 칩은 이미 똑똑해진 뇌를 가져와서 실행만 하는 ‘추론’ 역할을 할 뿐입니다. 진정한 학습(Training)은 엑사플롭스(Exaflops) 급의 연산 능력을 자랑하는 테슬라의 클러스터와 자체 설계한 학습용 슈퍼컴퓨터 ‘도조(Dojo)’에서 이루어집니다.

향후 자율주행 기술의 격차는 누가 더 많은 AI 연산 자원(Compute)을 쏟아부어 파라미터를 키우고, 더 양질의 비디오 데이터를 먹이느냐에 따라 결정되는 스케일링 법칙(Scaling Laws)을 철저히 따르게 될 것입니다. 마치 챗GPT가 텍스트 데이터를 먹고 진화했듯, FSD는 현실 세계의 물리 법칙이 담긴 비디오 토큰을 먹고 자라고 있습니다. 다른 레거시 완성차 업체들이 센서의 개수를 늘리고 라이다를 달며 하드웨어 스펙 경쟁에 매몰되어 있을 때, 테슬라는 이미 전 세계 도로를 돌아다니는 수백만 대의 차량에서 ‘그들이 실수한 코너 케이스 영상’만을 쪽쪽 빨아들여 모델을 재학습시키는 거대한 데이터 플라이휠(Data Flywheel)을 완성해 버렸습니다. 제가 오늘 아침 출근길에 오토파일럿이 풀려 브레이크를 밟았던 그 순간의 데이터조차, 결국 저 멀리 텍사스 기가팩토리 어딘가의 서버로 전송되어 FSD를 더 똑똑하게 만드는 한 줌의 밑거름이 되고 있을게 확실합니다.

💡 Insight Notes:

– 테슬라 FSD의 본질은 인간이 작성한 논리적인 제어 코드를 배제하고, 시각 데이터가 곧바로 차량의 물리적 제어로 직결되는 ‘엔드투엔드(End-to-End) 신경망’의 구현에 있습니다.

– 이러한 무거운 인공지능을 전력망이 제한된 차량 내부에서 실시간으로 구동하기 위해, 테슬라는 범용 GPU가 아닌 SRAM 집적도를 극대화한 독자적인 NPU 기반 FSD 칩을 설계하여 하드웨어 병목 현상을 타개했습니다.

※ 본 글은 작성일 기준의 데이터와 개인적 분석을 바탕으로 작성된 자율주행 기술력에 대한 글이며, 자산 추천에 대한 글이 아닙니다.